清华翟季冬:DeepSeek 百倍算力效能背后的系统革命 | 智者访谈

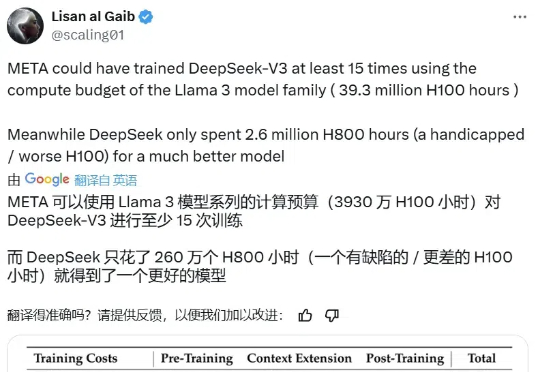

清华翟季冬:DeepSeek 百倍算力效能背后的系统革命 | 智者访谈2025 年伊始,全球 AI 业界被 DeepSeek 刷屏。当 OpenAI 宣布 5000 亿美元的「星际之门」计划,Meta 在建规模超 130 万 GPU 的数据中心时,这个来自中国的团队打破了大模型军备竞赛的既定逻辑:用 2048 张 H800 GPU,两个月训练出了一个媲美全球顶尖水平的模型。

2025 年伊始,全球 AI 业界被 DeepSeek 刷屏。当 OpenAI 宣布 5000 亿美元的「星际之门」计划,Meta 在建规模超 130 万 GPU 的数据中心时,这个来自中国的团队打破了大模型军备竞赛的既定逻辑:用 2048 张 H800 GPU,两个月训练出了一个媲美全球顶尖水平的模型。

"Deepseek R1不就是一个参数更大的语言模型吗?随便问问题就行了,还需要什么特殊技巧?"——当你说出这句话时,是否意识到自己正像《西游记》里高举紫金葫芦的妖怪,对着齐天大圣叫嚣:"我叫你的名字,你敢答应吗?"

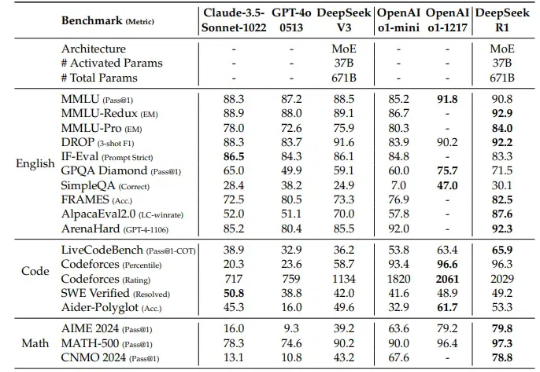

昨晚,杭州大模型又双叒不睡,给大伙儿拜年啦~就在春晚直播进行时,阿里通义Qwen发布新春节礼第三弹:Qwen2.5-Max来袭,多个基准测试中超越当红炸子鸡DeepSeek V3。

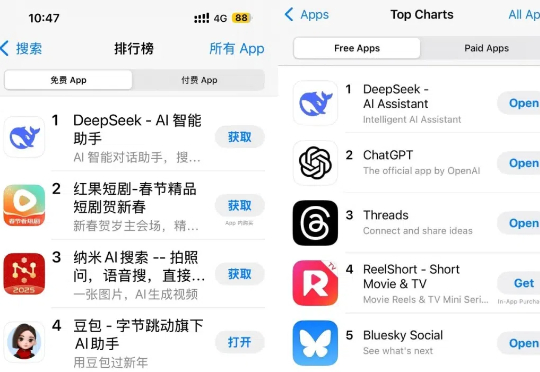

DeepSeek 20 日发布以来获得的热度至今依然没有任何消退的迹象。一觉醒来,DeepSeek 发布的 iOS 应用甚至超越了 ChatGPT 的官方应用,直接登顶 AppStore。

梁文锋,一个出生于广东五线城市的80后,父亲是一名小学老师。尽管家境平凡,他却凭借卓越的才智和不懈的努力,书写了一段非凡的人生篇章。自小便对数学和计算机科学展现出浓厚兴趣的梁文锋,17岁那年以优异的成绩考入了浙江大学,主修软件工程,专攻人工智能方向。大学期间,他不仅学业优异,还积极参与科研项目,为自己的未来奠定了坚实的基础。

就在本周,Kimi 的新模型打开了强化学习 Scaling 新范式,DeepSeek R1 用开源的方式「接班了 OpenAI」,谷歌则把 Gemini 2.0 Flash Thinking 的上下文长度延伸到了 1M。1 月 24 日上午,百川智能重磅发布了国内首个全场景深度思考模型,把这一轮军备竞赛推向了高潮。

「工程师正在疯狂地分析 DeepSeek,试图从中复制任何可能的东西。」DeepSeek 开源大模型的阳谋,切切实实震撼着美国 AI 公司。最先陷入恐慌的,似乎是同样推崇开源的 Meta。

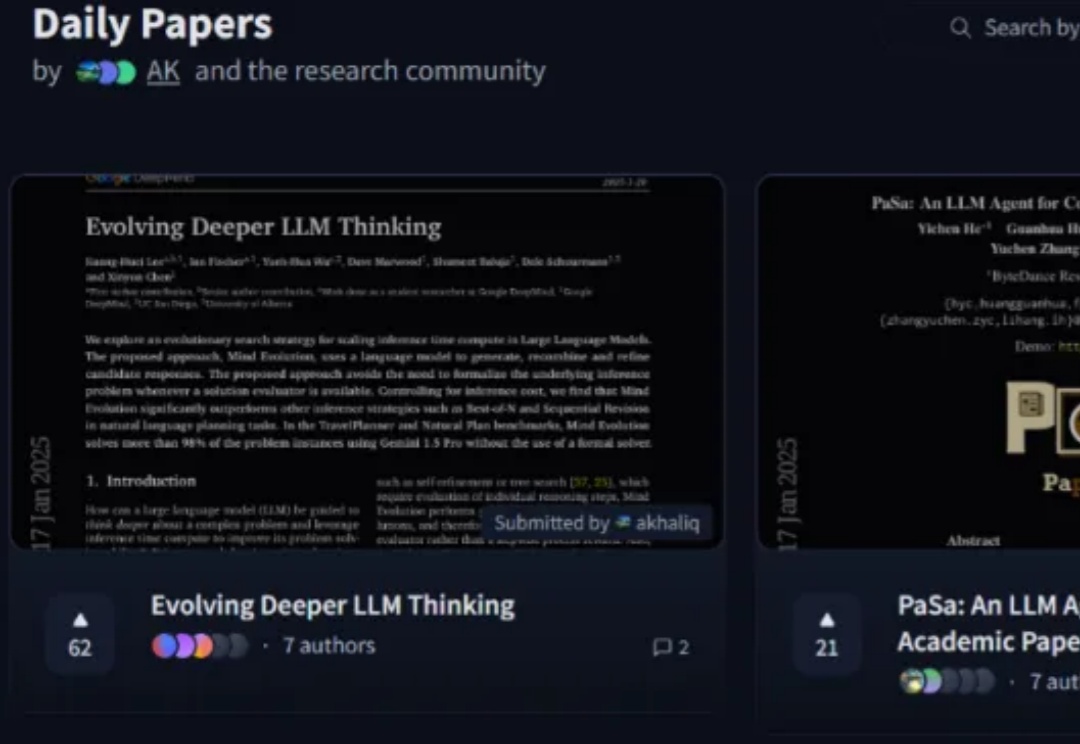

今天是个好日子,DeepSeek 与 Kimi 都更新了最新版的推理模型,吸引了广泛关注。与此同时,谷歌 DeepMind、加州大学圣地亚哥分校、阿尔伯塔大学的一篇新的研究论文也吸引了不少眼球,并直接冲上了 Hugging Face 每日论文榜第一(1 月 20 日)。

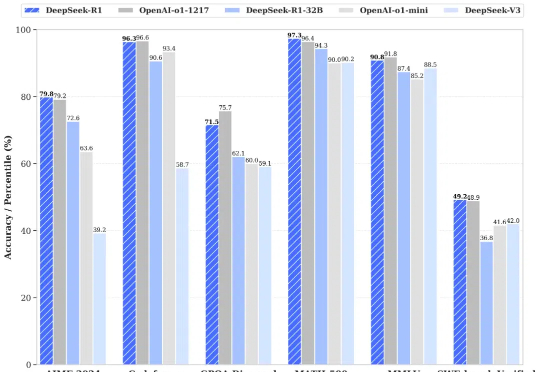

昨天晚上,DeepSeek 又开源了 DeepSeek-R1 模型(后简称 R1),再次炸翻了中美互联网: R1 遵循 MIT License,允许用户通过蒸馏技术借助 R1 训练其他模型。 R1 上线 API,对用户开放思维链输出 R1 在数学、代码、自然语言推理等任务上,性能比肩 OpenAI o1 正式版,小模型则超越 OpenAI o1-mini

中国版o1刷屏全网。DeepSeek R1成为世界首个能与o1比肩的开源模型,成功秘诀竟是强化学习,不用监督微调。AI大佬们一致认为,这就是AlphaGo时刻。